Semi-supervised Learning : comprendre cette méthode

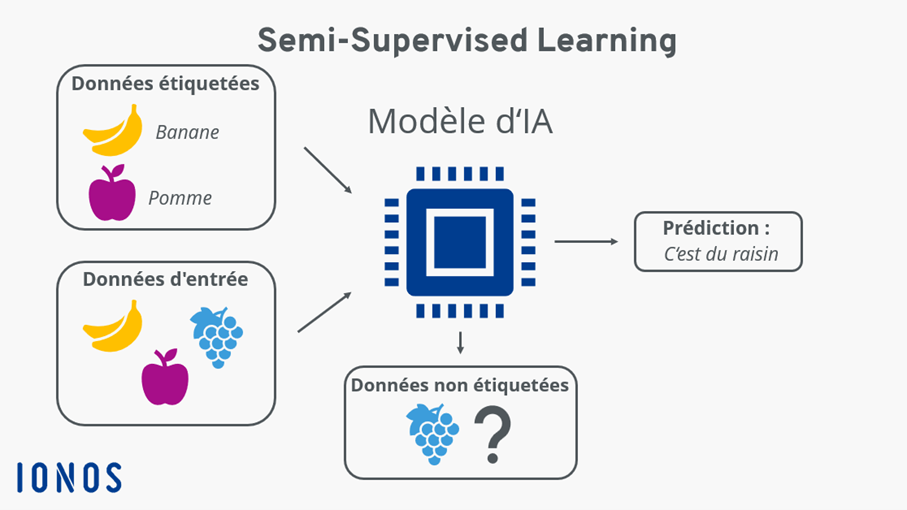

Lors du Semi-Supervised Learning, un modèle est entraîné à la fois avec des données étiquetées et non étiquetées. L’algorithme apprend ainsi à reconnaître des motifs dans les instances de données sans variable cible connue, à partir de quelques points de données étiquetés. Cette approche conduit à une modélisation plus précise et efficace.

Qu’est-ce que le Semi-Supervised Learning ?

Le Semi-Supervised Learning (en français appelé « apprentissage semi-supervisé » ou « apprentissage semi-encadré ») est une approche hybride dans le domaine de l’apprentissage automatique, qui combine les avantages de l’apprentissage supervisé et non supervisé. Ce processus utilise une petite quantité de données étiquetées avec une grande quantité de données non étiquetées pour entraîner des modèles d’IA. Cela permet à l’algorithme de détecter des motifs dans les ensembles de données non étiquetées, soutenus par les données étiquetées. Grâce à ce processus d’apprentissage combiné, le modèle comprend mieux la structure des données non étiquetées, ce qui conduit à des prédictions plus précises.

- Créez votre site Web en un temps record

- Boostez votre activité grâce au marketing par IA

- Gagnez du temps et obtenez de meilleurs résultats

Les principes du Semi-Supervised Learning

Les algorithmes conçus pour l’apprentissage semi-supervisé partent de plusieurs hypothèses sur les données :

- Hypothèse de continuité : les points proches les uns des autres ont plus de chances d’avoir la même sortie.

- Hypothèse de regroupement : les données peuvent être divisées en groupes discrets, et les points au sein du même groupe partagent probablement la même étiquette.

- Hypothèse de la variété : les données se situent approximativement sur une variété (ensemble de points liés), qui a une dimension inférieure à l’espace d’entrée. Cette hypothèse permet l’utilisation de distances et de densités.

Semi-Supervised Learning : quelle est la différence avec le Supervised et l’Unsupervised Learning ?

Le Supervised, l’Unsupervised et le Semi-Supervised Learning sont des approches fondamentales de l’apprentissage automatique (en anglais Machine Learning). Cependant, chacune de ces méthodes a sa propre approche pour entraîner des modèles d’IA. Le tableau ci-dessous montre les différences entre l’apprentissage semi-supervisé et les méthodes traditionnelles :

- Le Supervised Learning, appelée « apprentissage supervisé » en français, utilise uniquement des données étiquetées. Cela signifie que chaque exemple de données a une variable cible ou une solution connue que l’algorithme doit prédire. Cette approche est très précise, mais nécessite de grandes quantités de données étiquetées, souvent coûteuses et chronophages à obtenir.

- L’apprentissage non supervisé (Unsupervised Learning) utilise uniquement des données non structurées. L’algorithme cherche à détecter des motifs ou des structures sans solution prédéfinie. Cela est utile lorsqu’il n’existe pas de données étiquetées, mais peut être moins précis en raison du manque de points de référence externes.

- Le Semi-Supervised Learning combine ces deux approches en utilisant une petite quantité de données étiquetées pour comprendre la structure d’une grande quantité de données non étiquetées. Les techniques d’apprentissage semi-supervisé modifient un algorithme supervisé pour intégrer des données non étiquetées au modèle, ce qui permet d’obtenir des prédictions précises avec relativement peu d’efforts de marquage.

Un exemple pratique peut illustrer les différences entre ces approches d’apprentissage automatique. Si l’on prend des écoliers, on peut faire cette analogie : l’apprentissage supervisé signifie que les élèves sont surveillés à l’école et à la maison. Si les enfants doivent apprendre seuls, il s’agit d’apprentissage non supervisé. En revanche, lorsqu’un concept est expliqué en classe et approfondi par des devoirs, il s’agit d’apprentissage semi-supervisé.

Dans notre guide sur l’IA générative », nous expliquons en détail comment cette technologie fonctionne et quels sont ses principaux cas d’usage dans divers secteurs.

Comment fonctionne le Semi-Supervised Learning ?

Le Semi-Supervised Learning est un processus en plusieurs étapes :

- Définition des objectifs ou des problèmes : il est d’abord nécessaire de définir clairement les objectifs ou le but du modèle d’apprentissage automatique. L’accent est mis sur la question de savoir quelles optimisations l’apprentissage automatique doit atteindre.

- Étiquetage des données : certaines données non structurées sont étiquetées pour fournir une aide à l’algorithme d’apprentissage. Pour que le Semi-Supervised Learning fonctionne, il est nécessaire d’utiliser des données pertinentes pour la formation du modèle. Par exemple, si un classificateur d’images est entraîné à différencier les chiens et les chats, des images de voitures et de trains ne seraient pas appropriées.

- Entraînement du modèle : les données structurées sont ensuite utilisées pour apprendre au modèle quelle est sa tâche et quels résultats sont attendus.

- Entraînement avec des données non étiquetées : après que le modèle a appris avec les données d’entraînement, les données non étiquetées sont intégrées.

- Évaluation et ajustement du modèle : pour garantir que le modèle fonctionne correctement, des évaluations et ajustements sont nécessaires. Ce processus est répété jusqu’à ce que l’algorithme atteigne la qualité de résultats souhaitée.

Quels sont les avantages du Semi-Supervised Learning ?

L’apprentissage semi-supervisé est particulièrement avantageux lorsqu’un grand volume de données non étiquetées sont disponibles et qu’il serait trop coûteux ou difficile de les étiqueter toutes. Cela est important car la formation de modèles d’IA nécessite traditionnellement un grand nombre de données étiquetées fournissant le contexte nécessaire. Par exemple, pour qu’un modèle de classification d’images puisse distinguer deux objets (comme une table et une chaise) des centaines voire des milliers d’images d’entraînement étiquetées sont nécessaires. De plus, l’étiquetage des données, comme dans le domaine du séquençage génétique, peut nécessiter une expertise spécifique.

Grâce au Semi-Supervised Learning, il est possible d’atteindre une grande précision avec un faible nombre de données étiquetées, car les ensembles de données étiquetées renforcent les données non étiquetées. Les données structurées servent de point de départ, augmentant la vitesse et la précision de l’apprentissage de manière significative. Ainsi, cette approche permet de maximiser le potentiel d’une petite quantité de données étiquetées tout en utilisant un grand nombre de données non étiquetées, ce qui augmente l’efficacité des coûts.

Le Semi-Supervised Learning présente également des défis et des limitations : par exemple, si les données étiquetées initialement sont incorrectes, cela peut entraîner des conclusions erronées et affecter négativement la qualité du modèle. De plus, le modèle peut rapidement devenir biaisé si les données étiquetées et non étiquetées ne sont pas représentatives de la distribution globale.

Quels sont les principaux domaines d’application du Semi-Supervised Learning ?

Le Semi-Supervised Learning est désormais employé dans divers domaines, bien que les tâches de classification demeurent parmi ses utilisations les plus courantes. Voici un aperçu des principaux champs d’application :

- Classification de contenu Web : les moteurs de recherche comme Google utilisent l’apprentissage semi-supervisé pour évaluer la pertinence des pages Web par rapport à certaines requêtes de recherche.

- Classification de texte et d’images : l’objectif ici est de classer les textes ou les images dans une ou plusieurs catégories prédéfinies. Le Semi-Supervised Learning est particulièrement adapté à cela, car il existe une grande quantité de données non étiquetées, et l’étiquetage de tous les ensembles de données serait trop long et coûteux.

- Analyse de la parole : l’étiquetage des fichiers audio est également très coûteux. Le Semi-Supervised Learning offre une solution naturelle à ce problème.

- Analyse de séquences protéiques : en raison de la taille des brins d’ADN, l’apprentissage semi-supervisé est idéal pour analyser les séquences protéiques.

- Détection d’anomalies : le Semi-Supervised Learning permet de détecter des motifs inhabituels qui ne correspondent pas à la norme.